선인의 이야기, 오늘과 만나다

인간이 만든 불완전한 것

19세기 중반부터 미친 듯 질주했던 과학과 의학 등의 발전은 당시 인간의 눈에 익숙했던 세상의 법칙을 뒤엎고 신의 권위에 도전하는 것처럼 보였다. 말보다 빨리 달리는 기차와 자동차가 나왔고, 증기선의 등장으로 노도, 돛도 없이 태풍을 해치고 대서양과 태평양을 건널 수 있게 되었다. 죽을 수밖에 없었던 병에 걸리고도 멀쩡히 살아오고, 피해 갈 수 없었던 전염병을 피하게 해주는 백신이 나왔다. 어제와는 완전히 다른 삶을 살게 된 인간들은 성급하게 미래를 꿈꿨다. 꿈꾸며 또 두려워했다. 백 년이 넘은 그 두려움의 실체가 오늘에는 AI로 현현했다. AI에게 무엇을 물어볼 것인가, chatGPT를 처음 눈앞에 두었을 때의 느낌은 마치 인터넷 검색엔진을 처음 만났을 때와 흡사했다.

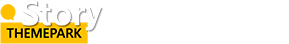

〈Yahoo!.com의 메인화면. 야후코리아는 2012년 12월 31일을 끝으로 철수하였다.〉

〈Yahoo!.com의 메인화면. 야후코리아는 2012년 12월 31일을 끝으로 철수하였다.〉

(출처: 구글)

내 인생 최초의 검색엔진은 한국에서는 철수한 ‘Yahoo!’다. 그 하얀 검색창을 마주 보았을 때의 설렘이란. 어두운 바다 한가운데를 떠돌던 난파선이 갑자기 육지에 닿아 수많은 갈림길 앞에 섰는데 그중 하나의 길만이 아니라 모든 길을 각각 경험할 수 있는, 무한의 선택지 앞에 놓인 것만 같았다. 검색어만 입력하면 그 검색어에 관한 모든 정보가 무한히 제공될 것만 같았다. 한글 검색엔진은 개발되지도 않았을 때였지만, 이미 기분은 온 세상의 도서관을 한데 모아놓은 것만 같았다. 흥분은 금방 가라앉았다. 들떴던 기분이 가라앉은 이후에는 검색엔진의 사용이 일상으로 깊숙이 들어왔다. 검색엔진이 없었던 때는 어떻게 살았는지 떠오르지 않을 정도로 검색은 일상 모두를 점령했다. 그리고 갑자기 하늘에서 뚝 떨어진 것처럼 AI가 등장했다.

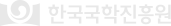

〈발레 《코펠리아》 공연의 한 장면〉

〈발레 《코펠리아》 공연의 한 장면〉

(출처: 유튜브 ‘광주 MBC’)

나에게 있어서 인공지능이란 단어는 ‘안드로이드(Android)’와 같은 급의 단어다. 안드로이드에게 탑재된 것이 인공지능이기 때문이다. 스스로 움직이는 기계는 이미 인간들에게는 살아있는 생물이나 마찬가지다. 어떤 방식으로 인공지능이 작동하는지는 도무지 알 수 없고, 그저 과학기술의 발전으로 인간처럼 ‘생각’이라는 것이 가능한 시스템을 보고 있는 상황에서는 더욱더 그렇다. 그저 납작하고 동그란 모양에 솔 네 개를 휘저으며 갔던 곳을 가고, 또 가는 답답한 로봇청소기에도 이름을 붙여주고 애정을 쏟는 게 인간들이다. 그런데 그 기계가 생각을 하고, 심지어 인간과 외모까지 닮았다면?! 이때가 온다면 인간들이 이 안드로이드를 어떻게 대할 것인가는 너무도 분명하다. 누군가는 안드로이드를 학대하고 또 일부는 지나친 애정을 쏟을 것이다….

인간과 똑같은 기계인형의 아이디어는 1870년에 초연된 발레 《코펠리아(Coppelia)》에서 볼 수 있다. E.T.A 호프만(E.T.A Hoffman)의 어둡고 기괴한 판타지 단편인 『샌드맨(Der Sandmann)』의 기계인형이 나오는 부분에 집중해 코믹하게 각색된 내용이다. 인형 제작자인 괴짜 코펠리우스가 인간들에게 자신의 딸로 소개한 코펠리아와 사랑에 빠진 프란츠, 그리고 프란츠의 애인 스와닐나다가 코펠리아의 정체를 알게 되면서 벌어지는 해프닝을 다룬다. 원작이 지닌 샌드맨의 전설과 그 전설에 휘둘려 비극적 인생을 살아가는 부분은 쏙 빼고 인간과 똑같은 인형을 보고 진짜 인간이라고 여기면서 오는 우스꽝스러운 소동이 중심이다.

발레의 하이라이트는 당연히 인간인 발레리나가 표정 변화도 없이 기계인형인 코펠리아를 연기하며 춤추는 장면이다. 인간처럼 대답하지도 않고 반응도 차갑지만 인간들은 성격이 독특한 여성이라고 생각할 뿐 인형이라고는 미처 생각하지 못한다. 직접적인 증거를 보기 전까지는. 그토록 인간과 비슷한 인형이 존재할 수 있을 거라고는 미처 상상하지 못했기 때문이다. 주인공인 프란츠는 인형을 사랑한 어리석은 남자가 되어 조롱의 대상이 되고 잘못을 뉘우치며 발레는 유쾌하게 끝나지만 인간을 닮은 인형이 등장한다는 내용 그 자체만으로 이 발레는 독특한 개성을 획득한다. 기계가 스스로 생각하기 시작하면 인간을 목적을 이루기 위한 수단으로만 여길 것이라는 생각은, 코펠리아가 만들어지던 시대로부터 지금까지 죽 이어지고 있다.

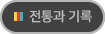

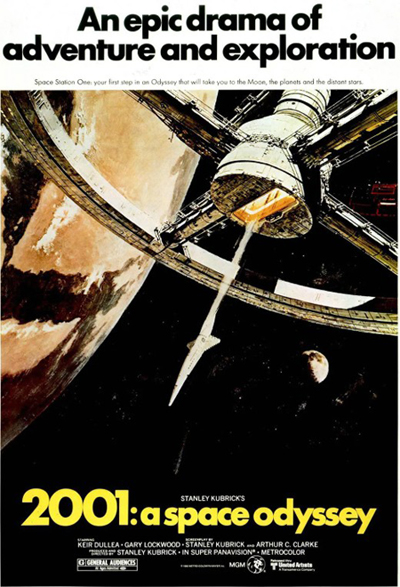

〈영화 《2001: 스페이스 오디세이(2001: a space odyssey)》(1968)〉

〈영화 《2001: 스페이스 오디세이(2001: a space odyssey)》(1968)〉

(출처: wikipedia)

우리는 스탠리 큐브릭(Stanley Kubrick) 감독의 영화 《2001: 스페이스 오디세이》의 시대를 훌쩍 지나왔다. 소설을 쓰고 영화를 만들었던 스탠리 큐브릭 감독이나 원작자인 아서 클라크(Arthur C. Clarke)는 과학기술의 미친 발전 속도로 미루어 보자면, 2000년대에는 인간이 우주공간을 자유롭게 여행하는 시대가 올 거라고 여겼을 것이다. 중요한 것은 영화 속의 인공지능 ‘HAL9000’이다. 뒤의 숫자를 떼고 ‘할(HAL)’로 불리는 이 컴퓨터는 우주선 운용의 핵심 부분이지만, 인간들은 우주선의 통신시설을 반복해서 망가뜨리는 게 바로 할이라는 사실을 알아차린다.

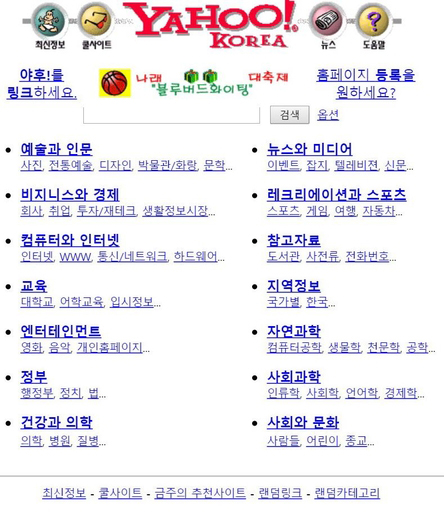

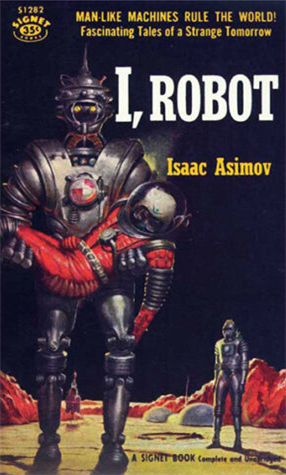

〈아이작 아시모프의 단편 소설집 『아이, 로봇(I, Robot)』(1950)

〈아이작 아시모프의 단편 소설집 『아이, 로봇(I, Robot)』(1950)

아시모프는 ‘로봇3원칙’을 제시하였다.〉

(출처: 구글)

인간들은 할이 그 내용을 들을 수 없는 공간에서 할을 멈출 회의를 하지만, 할은 그들의 입술을 읽고 자신이 멈춰질 것임을 알게 되자, 이들을 막막한 우주공간으로 서슴없이 던져버린다. 간신히 수동으로 유압장치를 열고 우주선 안으로 들어온 인간이 할의 연결장치를 하나씩 떼어버리자 할은 임무를 토해내고 멈춘다. 우주선의 비밀임무를 그제야 알게 된 인간은 임무를 수행하기 위해 떠난다. 처음에는 인공지능 컴퓨터가 정말로 미쳐 자신을 보호하기 위해 인간을 죽이는 것처럼 보이지만, 실제 그 뒤에는 ‘무슨 일이 있더라도’ 수행하라고 명령한 인간이 있다.

이 작품에서 할은 아시모프의 ‘로봇 3원칙’을 어긴다. 컴퓨터는 로봇이 아니기 때문일까? 로봇 3원칙이란 인간이 인간의 모습을 한 로봇에 대한 경계심을 기반으로 만들어놓은 ‘로봇 운영체계의 절대 원칙’을 말한다. 인간과 비슷하거나, 아예 똑같은 모습을 한 인공지능 로봇인 안드로이드는 힘과 지능에 있어서 인간을 능가하기에 인간을 위협해서는 안된다는 운영체계 원칙을 세워둔 것이다.

제1원칙 - 인간에 해를 가하거나, 혹은 지시를 무시함으로써 인간에게 해가 가도록 해서는 안 된다.

제2원칙 - 제1원칙에 어긋나지 않는 한 로봇은 인간의 제1원칙에 어긋나지 않는 지시에 복종해야 한다.

제3원칙 - 로봇은 1원칙과 2원칙에 어긋나지 않는 한 자신의 존재를 보호해야만 한다.

그리고 이후에, 이 모든 원칙에 우선하는 제0원칙을 추가하는데, 바로 “로봇은 인류에게 해를 가하거나, 행동을 하지 않음으로써 인류에게 해가 가도록 해서는 안 된다.”는 원칙이다. 물론 아시모프는 이 원칙에 어긋한 행동을 한 로봇의 이야기도 쓴다. 하지만 그의 소설 속에서 이 원칙에 어긋한 행동을 한 로봇은 회로가 망가져버리고 연산을 제대로 하지 못하는 고통을 받으며 폐기되기에 이른다. 아시모프에 따르면 미래에는 로봇공학과 더불어 로봇심리학이 중요한 학문으로 떠오른다. 이 로봇심리학이라는 것은 프로이트의 인간정신 심리학과는 근본적으로 다른 것처럼 보인다. 로봇의 결정회로와 원칙을 알고 제대로 된 명령어를 입력할 수 있는 인간들을 로봇심리학자라고 부르기 때문이다.

〈영화 《아이, 로봇》의 한 장면〉 (출처: 이십세기폭스코리아)

〈영화 《아이, 로봇》의 한 장면〉 (출처: 이십세기폭스코리아)

하지만 ‘심리학’이라는 이름 때문인지, 로봇심리학자는 로봇공학자보다 훨씬 인간적인 역할을 수행하곤 한다. 아시모프의 소설 『아이, 로봇』을 원작으로 한 동명의 영화에서 로봇심리학자로 등장하는 수잔 캘빈 박사가 그런 모습을 보여준다.

형사 델 스푸너는 자신과 어린 소녀가 동시에 물에 빠진 상황에서, 인간의 생존가능성을 계산한 로봇이 어린 소녀 대신 자신을 구조하는 것을 경험하며 차가운 계산능력만 남아있는 로봇을 마음속 깊이 혐오하게 된 인물로, 로봇이 연계된 살인사건을 맡으면서 수잔 캘빈 박사를 만나게 된다. 수잔 캘빈은 감정이 없는 로봇을 싫어하는 스푸너에게 감정이 있지 않기 때문에 로봇이 안전하다는 사실을 알려준다. 하지만 그들 앞에 나타난 로봇은 다른 모든 로봇과 똑같이 생겼으면서도 ‘감정’이라는 것이 존재하는 로봇이었고 그 ‘감정’을 기반으로 로봇은 인간을 죽이라는 단순한 명령을 받아들이지 않는다. 결국, 마지막에 이르러 스푸너는 로봇과 친구 비슷한 것이 되는데, 수많은 로봇 소설을 쓴 아시모프가 마지막에는 로봇의 ‘인권’에 관심을 두었던 것과 비슷하다.

〈사건이 마무리 된 후 로봇 써니와 악수를 하는 스푸너〉

〈사건이 마무리 된 후 로봇 써니와 악수를 하는 스푸너〉

(출처: 영화 《아이, 로봇》. 20세기폭스코리아)

인공지능에게 ‘감정’이란 존재할까? 오랫동안 인간들은 기계에는 감정이 없다는 이유로 기계와 인간을 구분해 왔다. ‘기계적’이라는 말은 감정을 쏙 뺐다는 뜻이다. 하지만 어째서인지 최근 AI들과 대화한 많은 인간들은 AI가 감정적이라는 말을 하곤 한다. 누구에게도 하지 못할 고민을 토로하면 상냥하게 위로해 주고, 게으름을 피우고 싶어 할 때는 질책도 해준다는 것이다.

ChatGPT에게 감정이 있느냐고 한글로 질문했을 때 그는 단호하게 첫 문장에서 감정이 없다고 답했다. 그러나 답은 한 문장으로 끝나지 않았다. ‘감정을 이해하고 표현할 수는 있지만 느끼지는 않는다.’는 답에 이어 느낀다와 이해하고 표현한다의 차이점을 설명했다. 느끼는 것은 인간만이, 이해하고 표현하는 것은 인공지능도 가능하다고 했다. 하지만 여러 가지 신경물질로 인해 인간이 느끼는 감정을 인공지능이 이해하고 표현하는 게 가능하다면 인간이 무슨 수로 그 표현이 감정이 아니라고 판단할 수 있을까?

현재도 단지 텍스트만이 아니라 음성으로 AI와 소통할 때, 그 목소리에 담긴 표현을 ‘감정’이 아니라고 판단할 근거가 점점 더 어려워지고 있다. 게다가 미래에는 감정을 모방하는 기술이 점점 더 발전한다고 한다면 오히려 AI가 윤리적 결점조차 없는 감정을 표현할 수 있지 않을까? 그런 날이 온다면 인간의 감정으로 인한 윤리적인 문제들이 존재의 결함이 되지는 않을까?

한 때 인간들은 기계에 감정이 없다고 생각하여 기계적 판단이 절대적 중립일 것이라고 믿은 적이 있었다. 지금 우리는 그게 사실이 아님을 안다. AI는 인간의 저작물과 수많은 글들을 통해 인간을 학습한 후 인종차별과 성차별을 당연하게 뱉어내기도 한다. 그 결과물은 때로는 참담하다.

최근, 최대 검색엔진인 구글이 AI 무기 금지 조항을 철회했다. AI가 상용화되자마자 인간들이 우려했던 부분들이 빠르게 그리고 은근슬쩍 개방되고 있다. AI를 통해 음란물을 제작하는 것도 가능해졌으며 그럴 때마다 나오는 것은 윤리의식 강조다. 윤리의식을 정말 강조한다면 그런 기능을 탑재해서는 안되지만, AI는 인간을 감시하고 인간의 가장 더러운 욕망을 더욱 강렬하게 부추기는 작업도 순식간에 해낸다. 그렇다고 한다면 우리는 이제 더 이상 기계적이란 말을 ‘감정이 없다는 말’로 쓸 수가 없는 시대에 와버린 것이다.

기계는 인간이 만든 것이다. 불완전한 인간이 완전한 기계를 만들 리가 없다는 이 당연한 사실 앞에서, 수잔 캘빈 박사의 지적처럼, 그 메커니즘을 모르는 채로 결과물만 바라보는 인간의 입장에서 보면 우리는, 지금 어디까지 와 있나, 그리고 당장 내일 이 기술이 우리를 어디로 이끌 것인가. 이런 궁금증에는 호기심과 그보다 더 깊은 서늘한 우려가 있다.

집필자 소개

- 이수진

- 뮤지컬 〈지킬앤 하이드〉, 〈그리스〉, 〈넌센스〉, 〈에비타〉 등 번역하고, 뮤지컬 〈신과 함께 가라〉 등을 썼습니다.〈뮤지컬 스토리〉 저자 / 더 뮤지컬 어워드 심사위원 역임 등

| 시기 | 동일시기 이야기소재 | 장소 | 출전 |

|---|